ビッグデータを扱う場合、間違いは避けられません。データの最下部に到達し、データに優先順位を付け、最適化し、視覚化し、適切なアイデアを得る必要があります。調査によると、85%の企業がデータ管理に取り組んでいますが、この分野での成功を報告しているのは37%にすぎません。実際には、失敗について話すのが好きな人はいないため、否定的な経験を研究することは困難です。アナリストは成功について喜んで話しますが、間違いが発生したらすぐに、「ノイズの蓄積」、「誤った相関関係」、「ランダムな内因性」について、詳細なしで聞く準備をしてください。ビッグデータの問題は本当に理論的なものにすぎませんか?

今日は、ユーザーとアナリストに具体的な影響を与える実際の間違いの経験を探ります。

サンプリングエラー

記事「ビッグデータ:大きな間違い? »スタートアップのStreetBumpで興味深い話を思い出しました。同社はボストンの住民に、モバイルアプリケーションを使用して路面の状態を監視するよう依頼しました。ソフトウェアは、スマートフォンの位置と標準からの異常な逸脱(ピット、バンプ、ポットホールなど)を記録しました。受信したデータは、市役所の希望する宛先にリアルタイムで送信されました。

しかし、ある時点で、市長室は貧しい人々よりも豊かな地域からの苦情がはるかに多いことに気づきました。状況を分析したところ、裕福な居住者はインターネットに常時接続された電話を持っており、より頻繁に運転し、StreetBumpを含むさまざまなアプリケーションのアクティブユーザーであったことがわかりました。

その結果、調査の主な目的はアプリケーション内のイベントでしたが、統計的に有意な関心のある単位は、モバイルデバイスを使用している人であると想定されていました。スマートフォンユーザー(当時中高所得の白人アメリカ人がほとんど)の人口統計を考えると、データの信頼性がいかに低いかが明らかになりました。

意図しないバイアスの問題は、何十年もの間、ある研究から別の研究へとさまよっています。ソーシャルネットワーク、アプリ、またはハッシュタグを他の人よりも積極的に使用する人は常に存在します。データ自体は十分ではありません-品質は最も重要です。アンケートが調査結果に影響を与えるのと同じように、データを収集するために使用される電子プラットフォームは、これらのプラットフォームで作業するときの人々の行動に影響を与えることにより、研究結果を歪めます。研究「ビッグデータソースの選択性処理方法のレビュー」の

著者によると、正確な統計分析を目的としていない多くのビッグデータソースがあります-インターネット調査、TwitterとWikipediaのページビュー、Googleトレンド、ハッシュタグ頻度分析など。

この種の最も明白な間違いの1つは、2016年の米国大統領選挙でのヒラリークリントンの勝利を予測することです。投票開始の数時間前に発表されたロイター/イプソスの世論調査によると、クリントンは90%勝つ可能性が高かった。研究者たちは、方法論的には調査自体は完璧に行われた可能性があると示唆しているが、50州の15,000人からなる基地は不合理に振る舞った-おそらく多くの人がトランプに投票したいと認めなかった。

相関エラー

理解できない相関関係と紛らわしい因果関係は、初心者のデータ科学者を困惑させることがよくあります。その結果、数学的には完璧で、実際には完全に実行不可能なモデルが得られます。

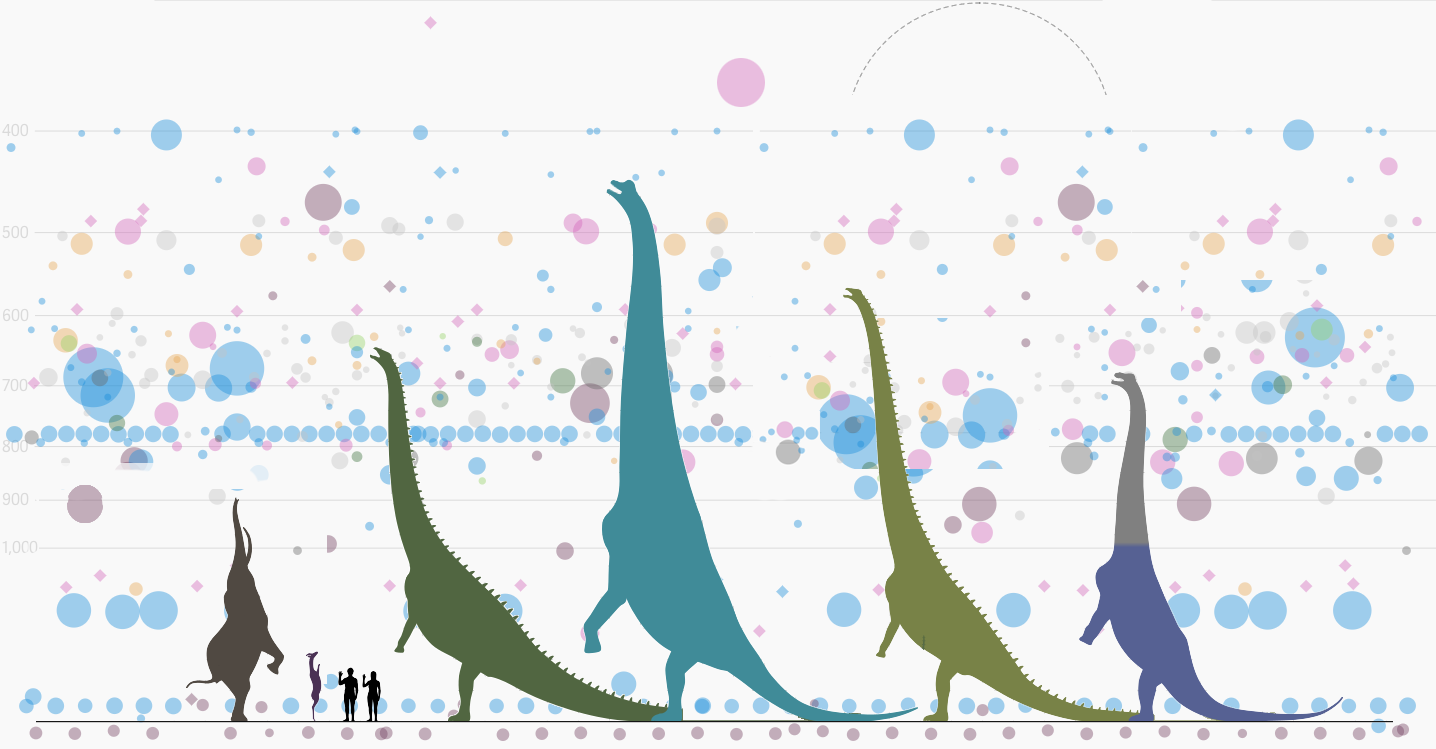

上のグラフは、 1963年以降のUFO目撃の総数を示しています。 National UFO Reporting Centerデータベースから報告された症例数は、長年にわたってほぼ同じままでしたが、1993年に急増しました。

したがって、27年前にエイリアンが地球人の研究を本格的に始めたという完全に論理的な結論を下すことができます。本当の理由は、X-Filesの最初のエピソードが1993年9月にリリースされたためです(ピーク時には、米国で2,500万人以上が視聴していました)。

次に、時間帯と曜日に応じたUFO目撃の頻度を示すデータを見てください。目撃の最も高い頻度は黄橙色です。明らかに、エイリアンは週末に仕事に行くので、より頻繁に地球に着陸します。それで、人々を研究することは彼らにとっての趣味ですか?

これらの陽気な相関関係には、広範囲にわたる影響があります。たとえば、低所得コミュニティでの印刷へのアクセスに関する研究では、より多くの本にアクセスできる学生はより良い成績をとることがわかりました。科学的研究のデータに導かれて、フィラデルフィア(米国)の当局は教育システムを再編成し始めました。

5年間のプロジェクトでは、フィラデルフィアのすべての子供と家族に平等な機会を提供するために32の図書館を改築しました。一見、計画は素晴らしく見えましたが、残念ながら、この研究では、子供たちが実際に本を読んだかどうかは考慮されていませんでした。本が入手可能かどうかという問題だけが調べられました。

その結果、有意な結果は得られませんでした。研究前に本を読んでいなかった子供たちは、突然読書に夢中になりませんでした。市は数百万ドルを失い、恵まれない地域の学童の成績は向上せず、本を愛して育った子供たちは彼らと同じように学び続けました。

データロス

(c)

サンプルが正しい場合もありますが、作成者は分析する必要のあるデータを失うだけです。これは、「Freakonomics」という名前で世界中に広く配布されている作品で起こりました。総発行部数が400万部を超えたこの本は、非自明な因果関係の出現の現象を探求しました。たとえば、この本の注目を集めるアイデアの中には、米国で10代の犯罪が減少した理由は、経済と文化の成長ではなく、中絶の合法化であるという考えがあります。

シカゴ大学の経済学教授である「Freakonomics」の著者であるStephenLevittとジャーナリストのStephenDubnerは、数年後に認めました。データが単に消えたので、収集された数字のすべてが最終的な中絶調査に含まれていなかったこと。Levittは、その時点で「彼らは非常に疲れていた」という事実によって方法論的な誤算を説明し、研究の全体的な結論のためにこれらのデータの統計的重要性に言及しました。

中絶が実際に将来の犯罪を減らすかどうかはまだ議論の余地があります。しかし、著者は他の多くの間違いに気づきました、そしてそれらのいくつかは1990年代のufologyの人気の状況に驚くほど似ています。

分析エラー

(c)

Biotechは、ハイテク起業家にとって新しいロックンロールになりました。生物医学情報の処理に携わる企業の投資家の間で爆発的な人気を示していることから、「新しいIT市場」、さらには「新しい暗号の世界」とも呼ばれています。

バイオマーカーと細胞培養データが「新油」であるかどうかは二次的な問題です。速いお金を業界に送り込むことの結果は興味深いものです。結局のところ、バイオテクノロジーはVCウォレットに脅威を与えるだけでなく、人間の健康にも直接影響を与える可能性があります。

たとえば、指摘するように遺伝学者のスティーブン・リプキン氏は、ゲノムには高品質の分析を行う能力がありますが、品質管理情報は医師や患者に立ち入り禁止になっていることがよくあります。テストを注文する前に、シーケンスカバレッジの深さが事前にわからない場合があります。遺伝子が十分なカバレッジのために十分な回数読み取られない場合、ソフトウェアは何もないところに変異を見つけます。多くの場合、遺伝子の対立遺伝子を有益なものと有害なものに分類するためにどのアルゴリズムが使用されているかがわかりません。

ある大はエラーを含む遺伝学の分野の科学論文の数。オーストラリアの研究者チームは、多くの主要な科学雑誌に掲載された約3.6千の遺伝子論文を分析しました。その結果、5作品に1作品がエラー遺伝子をリストに含んでいることがわかりました。

これらのエラーの原因は目を見張るものがあります:データの統計処理に特別な言語を使用する代わりに、科学者はすべてのデータをExcelスプレッドシートに要約しました。 Excelは、遺伝子名をカレンダーの日付またはランダムな番号に自動的に変換しました。そして、何千もの行を手動で再チェックすることは単に不可能です。

科学文献では、遺伝子はしばしば記号で示されます。たとえば、Septin-2遺伝子はSEPT2に短縮され、Membrane Associated Ring Finger(C3HC4)1-はMARCH1に短縮されます。 Excelはデフォルト設定を使用して、これらの文字列を日付に置き換えました。研究者たちは、彼らが問題の先駆者にはならなかったと述べました-それは10年以上前に指摘されました。

別のケースでは、Excelは経済に大きな打撃を与えました。ハーバード大学のカルメン・ラインハートとケネス・ロゴフの有名なエコノミストは、研究活動において、公的債務の増加と42か国の経済成長への影響の3,700の異なる事例を分析しました。

「債務期間中の成長」という研究は、公的債務のレベルがGDPの90%を下回っている場合、それは実質的に経済成長に影響を与えないことを明確に示しています。国の債務がGDPの90%を超えると、成長率の中央値は1%低下します。

この研究は、世界が最近の経済危機にどのように取り組んでいるかに大きな影響を与えました。この作業は、米国とヨーロッパでの予算削減を正当化するために広く引用されています。

しかし、数年後、マサチューセッツ大学のThomas Herndorn、Michael Ash、Robert Pollinは、RogoffとReinhartの作業をポイントごとに分析した後、Excelを使用する際のありふれた不正確さを明らかにしました。実際、統計では、GDPの成長と公的債務との関係は示されていません。

結論:バグの原因としてのバグ修正

(c)

分析する情報が膨大であることを考えると、これが物事の性質であるという理由だけで、いくつかの誤解が生じます。エラーがまれでランダムに近い場合、最終的な分析の結論は損なわれない可能性があります。場合によっては、データ収集のエラーとの闘いが新しいエラーにつながる可能性があるため、それらに対処することが無意味です。

有名な統計学者のエドワード・デミングは、このパラドックスの説明を次のように定式化しました。最良の結果を達成するために、既存の小さな偏差を補正する安定したプロセスを設定すると、プロセスに干渉がない場合よりも悪い結果につながる可能性があります。

データの過剰補正の問題を説明するために、誤って漏斗からボールを落とすプロセスでの補正のシミュレーションを使用します。プロセスはいくつかのルールを使用して調整できます。その主な目的は、漏斗の中心にできるだけ近づく機会を提供することです。ただし、ルールに従うほど、結果は苛立たしくなります。

漏斗を試す最も簡単な方法は、シミュレーターが作成されたオンラインです。あなたが達成した結果をコメントに書いてください。

Mail.ruGroupの無料教育プロジェクトであるMADEAcademy で、ビッグデータを適切に分析する方法をお教えします。トレーニングの申し込みは8月1日まで受け付けています。