こんにちは住民!自然言語のテキストを処理および生成するための実用的なガイドを公開しました。この本には、仮想アシスタント(チャットボット)、スパムフィルター、フォーラムモデレータープログラム、感情アナライザー、ナレッジベース構築プログラム、インテリジェントな自然言語テキストアナライザー、またはの操作を保証するために適用されるNLPシステムを作成するために必要なすべてのツールとテクニックが備わっています。考えられる他のほとんどすべてのNLPアプリケーション。

こんにちは住民!自然言語のテキストを処理および生成するための実用的なガイドを公開しました。この本には、仮想アシスタント(チャットボット)、スパムフィルター、フォーラムモデレータープログラム、感情アナライザー、ナレッジベース構築プログラム、インテリジェントな自然言語テキストアナライザー、またはの操作を保証するために適用されるNLPシステムを作成するために必要なすべてのツールとテクニックが備わっています。考えられる他のほとんどすべてのNLPアプリケーション。

この本は、中級から上級のPython開発者を対象としています。この本の重要な部分は、複雑なシステムの設計と開発の方法をすでに知っている読者に役立ちます。これは、推奨されるソリューションの例が多数含まれており、最新のNLPアルゴリズムの機能が明らかになっているためです。Pythonでのオブジェクト指向プログラミングの知識は、より良いシステムを構築するのに役立ちますが、この本の情報を使用する必要はありません。

あなたは本の中で何を見つけますか

I . , . , , , , , . -, , 2–4, . , 90%- 1990- — .

, . , , , ( ). , - , . , .

. II . «» , : , , .

, , . , , . « » , , .

III, , , .

, . , , , ( ). , - , . , .

. II . «» , : , , .

, , . , , . « » , , .

III, , , .

フィードバックニューラルネットワーク:反復ニューラルネットワーク

第7章では、畳み込みニューラルネットワークを使用してフラグメントまたは文全体を分析し、共有重みフィルター(畳み込みを実行)を適用して文内の隣接する単語を追跡する可能性を示します。グループで発生する単語もバンドルで見つけることができます。ウェブは、これらの単語の位置の小さなずれにも耐性があります。同時に、隣接する概念がネットワークに大きな影響を与える可能性があります。しかし、何が起こっているのか全体像を見る必要がある場合は、長期間にわたる関係、つまり供給から3〜4個以上のトークンをカバーするウィンドウを考慮に入れてください。過去のイベントの概念をネットワークに導入するにはどうすればよいですか?記憶?

フィードフォワードニューラルネットワークの各トレーニング例(または無秩序な例のバッチ)および出力(または出力のバッチ)について、逆伝播法に基づいて、個々のニューロンに対してニューラルネットワークの重みを調整する必要があります。これはすでに実証済みです。ただし、次の例のトレーニングフェーズの結果は、入力データの順序にほとんど依存していません。畳み込みニューラルネットワークは、ローカルの関係をキャプチャすることによってこれらの順序の関係をキャプチャしようとしますが、別の方法があります。

畳み込みニューラルネットワークでは、各トレーニング例はグループ化されたワードトークンのセットとしてネットワークに渡されます。単語ベクトルは、図に示すように、(単語ベクトルの長さ×例の単語数)の形式でマトリックスにグループ化されます。 8.1。

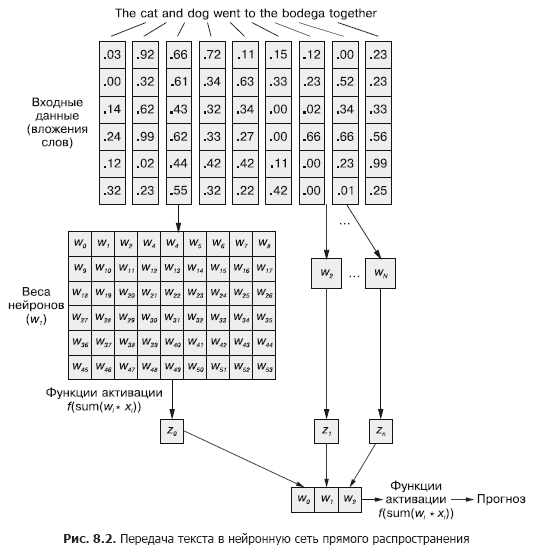

しかし、この一連の単語ベクトルは、第5章(図8.2)から通常のフィードフォワードニューラルネットワークに同じように簡単に伝えることができますよね?

もちろん、これは完全に実行可能なモデルです。入力データを渡すこの方法を使用すると、フィードフォワードニューラルネットワークは、トークンの共同発生に応答できるようになります。これが必要です。しかし同時に、長いテキストで区切られているか、互いに隣接しているかに関係なく、すべての共同発生に同じように反応します。さらに、CNNのようなフィードフォワードニューラルネットワークは、可変長ドキュメントの処理が不十分です。Webの幅を超えると、ドキュメントの最後にあるテキストを処理できなくなります。

フィードフォワードニューラルネットワークは、データサンプル全体とそれに対応するラベルとの関係をモデル化するのに最適です。文頭と文末の単語は、意味的に相互に関連している可能性は低いですが、出力信号に中央と同じ影響を及ぼします。

このような均一性(影響の均一性)は、たとえば、「いいえ」や「良い」などの厳しい否定トークンや修飾子(形容詞や副詞)の場合に明らかに問題を引き起こす可能性があります。フィードフォワードニューラルネットワークでは、否定語は、実際に影響を与えるべき場所から遠く離れていても、文中のすべての単語の意味に影響を与えます。

1次元の畳み込みは、ウィンドウ全体で複数の単語を解析することにより、トークン間のこれらの関係を解決する方法です。第7章で説明するダウンサンプリング層は、単語の順序の小さな変更に対応するように特別に設計されています。この章では、ニューラルネットワークメモリの概念に向けた最初の一歩を踏み出すのに役立つ別のアプローチを見ていきます。言語をデータの大きなチャンクとして分解する代わりに、時間の経過とともに、トークンごとに、その順次形成を調べ始めます。

8.1。ニューラルネットワークでの暗記

もちろん、文中の単語が互いに完全に独立していることはめったにありません。それらの出現は、ドキュメント内の他の単語の出現によって影響を受けるか、影響を受けます。例:盗まれた車がアリーナに急行し、ピエロの車がアリーナに急行しました。

最後まで読んでいくと、2つの文の印象がまったく異なる場合があります。それらの中のフレーズの構成は同じです:形容詞、名詞、動詞および前置句。しかし、それらの中の形容詞の置き換えは、読者の観点から起こっていることの本質を根本的に変えます。

そのような関係をモデル化する方法は?アリーナとスピードでさえ、それらのいずれかを直接定義していない文の前に形容詞がある場合、わずかに異なる意味を持つ可能性があることをどのように理解しますか?

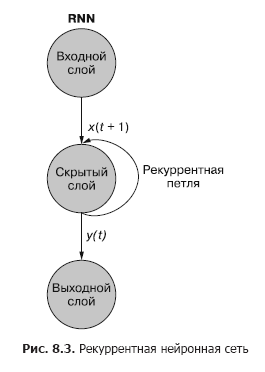

少し前に何が起こったかを覚える方法があれば(特に、ステップt + 1のステップtで何が起こったかを覚えておく)、特定のトークンが他のトークンに関連付けられた一連のパターンに現れるときに発生するパターンを識別することができます。リカレントニューラルネットワーク(RNN)を使用すると、ニューラルネットワークでシーケンスの過去の単語を記憶することができます。

あなたが図で見ることができるように。 8.3では、隠れ層とは別の再発ニューロンがネットワークに再発ループを追加して、時間tで隠れ層の出力を「再利用」します。時間tの出力は、時間t +1の次の入力に追加されます。ネットワークはこの新しい入力を時間ステップt + 1で処理して、時間t +1の隠れ層出力を生成します。この出力は時間t + 1です。その後、ネットワークによって再利用され、タイムステップt +2などで入力信号に含まれます。

時間の経過とともに状態に影響を与えるという考えは少し混乱しているように見えますが、基本的な概念は単純です。タイムステップtでの従来のフィードフォワードニューラルネットワークの入力での各信号の結果は、タイムステップt + 1でネットワーク入力に供給される次のデータとともに追加の入力信号として使用されます。ネットワークは、現在何が起こっているかだけでなく、以前に何が起こったかについての情報も受け取ります。 ..。

. , . , . , . , . , , . . , .

t . , t = 0 — , t + 1 — . () . , . — .

t, — t + 1.

再発性神経回路網は、図に示すように視覚化できます。 8.3:円は、1つまたは複数のニューロンで構成されるフィードフォワードニューラルネットワークのレイヤー全体に対応します。隠れ層の出力は通常どおりネットワークによって発行されますが、次のタイムステップの通常の入力データとともに独自の(隠れ層)入力として返されます。この図は、このフィードバックループを、レイヤーの出力から入力に戻るアークとして示しています。

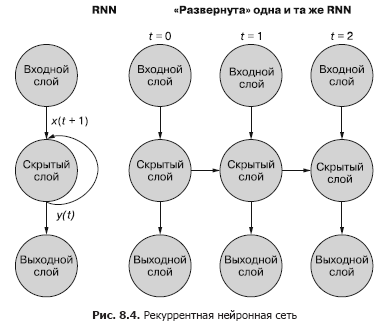

このプロセスを説明するためのより簡単な(そしてより一般的に使用される)方法は、ネットワーク展開を使用することです。図8.4は、時間変数(t)の2つのスイープ(ステップt +1とt + 2のレイヤー)を使用した逆さまのネットワークを示しています。

各タイムステップは、ニューロンの列の形で同じニューラルネットワークの拡張バージョンに対応します。これは、いつでもニューラルネットワークのスクリプトまたは個々のビデオフレームを見るようなものです。右側のネットは、左側のネットの将来のバージョンを表しています。時間(t)での隠れ層の出力信号は、右側の次のタイムステップ(t + 1)の入力データとともに隠れ層の入力にフィードバックされます。もう一度。この図は、この展開の2つの反復、t = 0、t = 1、およびt = 2の合計3列のニューロンを示しています。

この図のすべての垂直ルートは完全に類似しており、同じニューロンを示しています。それらは、異なる時点で同じニューラルネットワークを反映します。この視覚化は、エラーの逆伝播中にネットワーク上で情報が前後に移動することを示すのに役立ちます。ただし、展開されているこれら3つのネットワークを見るときは、覚えておいてください。これらは、同じ重みのセットを持つ同じネットワークの異なるスナップショットです。

展開する前に、反復ニューラルネットワークの元の表現を詳しく見て、入力信号と重みの関係を示しましょう。このRNNの個々のレイヤーは、図に示すように見えます。 8.5および8.6。

すべての潜在状態ニューロンには、従来のフィードフォワードネットワークと同様に、各入力ベクトルの各要素に適用される一連の重みがあります。しかし、このスキームでは、トレーニング可能な重みの追加セットが表示され、前のタイムステップからの隠れニューロンの出力信号に適用されます。ネットワークは、トレーニングによって、トークンごとにシーケンストークンを入力するときに、前のイベントの適切な重み(重要度)を選択します。

«», t = 0 t – 1. «» , , . t = 0 . , .

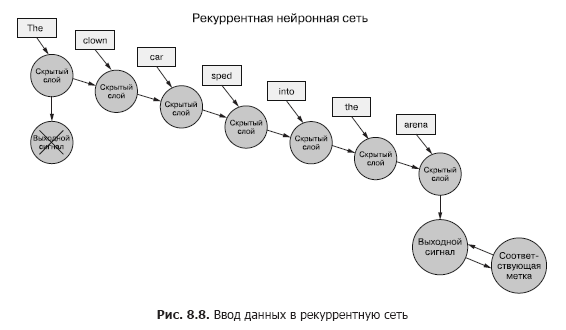

データに戻って、それぞれがラベル付きの例である一連のドキュメントがあると想像してください。また、前の章(図8.7)のように、単語ベクトルのセット全体を各サンプルの畳み込みニューラルネットワークに渡す代わりに、サンプルデータを一度に1トークンずつRNNに転送します(図8.8)。

最初のトークンの単語のベクトルを渡し、反復ニューラルネットワークの出力を取得します。次に、2番目のトークンを転送し、それを使用して最初のトークンからの出力信号を転送します。その後、2番目からの出力信号と一緒に3番目のトークンを転送します!等。現在、私たちのニューラルネットワークには、「前」と「後」の原因と結果の概念がありますが、あいまいではありますが、時間の概念もあります(図8.8を参照)。

今、私たちのネットワークはすでに何かを覚えています!まあ、ある程度は。まだ理解していないことがいくつかあります。まず、このような構造でエラーの逆伝播をどのように発生させることができますか?

8.1.1。時間内のエラーの逆伝播

上記のすべてのネットワークにはターゲットラベル(ターゲット変数)があり、RNNも例外ではありません。ただし、各トークンのラベルの概念はなく、各サンプルテキストのすべてのトークンのラベルは1つだけです。サンプルドキュメントのラベルのみがあります。

各タイムステップでネットワークへの入力としてトークンについて話しますが、反復ニューラルネットワークは任意の時系列データでも機能します。トークンは、任意、個別、または連続にすることができます:気象ステーションの読み取り値、メモ、文中の記号など。

ここでは、最初に最後のタイムステップでのネットワークの出力をキューと比較します。これは(今のところ)エラーと呼ばれるものです。つまり、ネットワークはエラーを最小限に抑えようとしています。ただし、前の章とは少し異なります。データの特定のサンプルは、ニューラルネットワークに順番に供給される小さな断片に分割されます。ただし、これらの各サブ例の出力を直接使用する代わりに、ネットワークに送り返します。

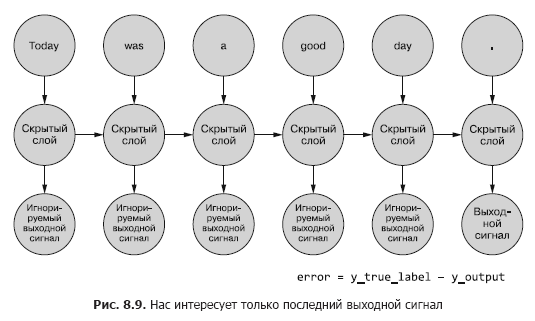

これまでのところ、最終的な出力信号のみに関心があります。シーケンス内の各トークンはネットワークに供給され、損失は最後のタイムステップ(トークン)の出力に基づいて計算されます(図8.9)。

特定の例にエラーがあるかどうか、更新する重みとその量を決定する必要があります。第5章では、通常のネットワークを介してエラーを逆伝播する方法を示しました。そして、重み補正の量は、エラーへの(この重みの)寄与に依存することがわかっています。サンプルシーケンスからネットワークの入力にトークンをフィードし、その出力信号に基づいて前のタイムステップのエラーを計算できます。これは、エラーを時間内に逆伝播するという考えがすべてを混乱させるように見える場所です。

ただし、それは時間制限のあるプロセスと単純に考えることができます。各タイムステップで、t = 0の最初のトークンから始まるトークンが、前にある隠れたニューロンの入力に一度に1つずつ供給されます(図の次の列)。 8.9。同時に、ネットワークが拡張され、ネットワークの次の列が表示され、シーケンス内の次のトークンを受信する準備ができています。オルゴールやメカニカルピアノのように、潜在的なニューロンは一度に1つずつ展開します。最終的に、例のすべての要素がネットワークに供給されると、展開するものはなくなり、対象のターゲット変数の最終的なラベルを取得します。これを使用して、エラーを計算し、重みを調整できます。この展開されたネットの計算グラフをずっと下に移動しました。

今のところ、入力データは一般的に静的であると考えています。どの入力信号がどのニューロンに入るのかをグラフ全体で追跡できます。また、どのニューロンがどのように機能するかがわかっているので、従来のフィードフォワードニューラルネットワークの場合と同じように、同じパスに沿ってチェーンに沿ってエラーを伝播できます。

エラーを前のレイヤーに伝播するために、チェーンルールを使用します。前のレイヤーの代わりに、デプロイされたすべてのネットワークバリアントが異なっているかのように、過去の同じレイヤーにエラーを伝播します(図8.10)。これは計算数学を変更しません。

エラーは最後のステップから伝播します。新しいタイムステップに対する以前のタイムステップの勾配が計算されます。この例では、ステップt = 0までのすべての個別のトークンベースの勾配を計算した後、変更が集約され、1セットの重みに適用されます。

8.1.2。いつ更新するか

奇妙なRNNを通常のフィードフォワードニューラルネットワークのようなものに変えたので、重みの更新はそれほど難しくないはずです。ただし、注意点が1つあります。秘訣は、ニューラルネットワークの別のブランチで重みがまったく更新されないことです。各ブランチは、異なる時点での同じネットワークを表します。各タイムステップの重みは同じです(図8.10を参照)。

この問題の簡単な解決策は、更新を遅らせて、各タイムステップで重みの補正を計算することです。フィードフォワードネットワークでは、特定の入力信号に対してすべての勾配が計算されるとすぐに、重みのすべての更新が計算されます。ここではまったく同じですが、特定の入力サンプルデータの最初の(ゼロ)タイムステップに到達するまで更新は延期されます。

勾配の計算は、エラーの原因となった重みの値に基づいて行う必要があります。最も圧倒的な部分は次のとおりです。タイムステップtでの重みが、何らかの形でエラーの原因になっています。また、同じ重みがタイムステップt + 1で異なる入力信号を受信します。これは、同じ重みがエラーに対して異なる寄与をすることを意味します。

各タイムステップでの重みのさまざまな変化を計算し、それらを合計してから、トレーニングフェーズの最後のステップとして、グループ化された変更を非表示レイヤーの重みに適用できます。

, . , , . , , . , .

本当の魔法。エラーが時間に戻って伝播すると、個々の重みは、タイムステップtで一方向に補正され(タイムステップtでの入力信号への応答に応じて)、次にタイムステップt-1で他の方向に補正されます( 1つのデータサンプルについて、タイムステップt-1)で入力信号にどのように反応したか!ニューラルネットワークは一般に、中間ステップの複雑さに関係なく、損失関数を最小化することに基づいていることを忘れないでください。集合的に、ネットワークはこの複雑な機能を最適化します。重みの更新はサンプルデータに1回だけ適用されるため、ネットワーク(もちろん収束する場合)は、特定の入力信号と特定のニューロンに対して、この意味で最終的に最適な重みで停止します。

前の手順の結果は依然として重要です

すべての中間タイムステップで生成された値のシーケンス全体が重要な場合があります。第9章では、特定のタイムステップtの出力が最後のタイムステップの出力と同じくらい重要である状況の例を提供します。図では8.11は、任意のタイムステップのエラーデータを収集し、それを伝播してすべてのネットワークの重みを修正する方法を示しています。

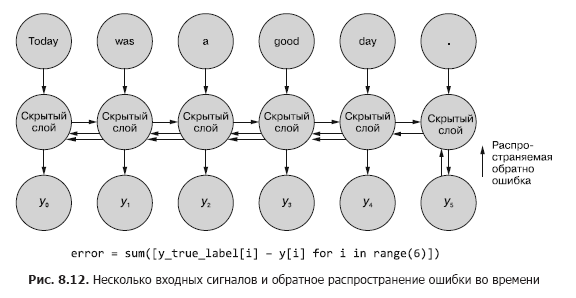

このプロセスは、nタイムステップの時間内のエラーの通常の逆伝播に似ています。この場合、同時に複数のソースからバグを伝播します。ただし、最初の例のように、重みの調整は加算的です。エラーは、最初の最後のタイムステップから最初のタイムステップまで、各重みの変化の合計とともに伝播します。次に、最後から2番目のタイムステップで計算されたエラーでも同じことが起こり、t = 0までのすべての変更が合計されます。このプロセスは、タイムステップ0に到達するまで繰り返され、エラーが1つだけであるかのように逆伝播します。次に、累積的な変更が対応する非表示レイヤーに一度に適用されます。

図では図8.12は、エラーが各出力信号からt = 0まで伝播し、重みの最終補正の前に集計される方法を示しています。これがこのセクションの主なアイデアです。従来のフィードフォワードニューラルネットワークの場合と同様に、重みは、特定の入力信号(または入力信号のセット)の逆伝播ステップ全体の重みの提案された変化を計算した後にのみ更新されます。 RNNの場合、エラー伝播には時間t = 0までの更新が含まれます。

重みを以前に更新すると、勾配計算が歪んでしまい、以前は逆伝播エラーが発生していました。勾配は特定の重みを基準にして計算されることを忘れないでください。この重みの更新が早すぎる場合、たとえばタイムステップtで、タイムステップt -1で勾配を計算すると、重み値(これはネットワーク内の重みの同じ位置であることを思い出してください)が変化します。また、タイムステップt -1からの入力信号に基づいて勾配を計算すると、計算が歪んでしまいます。実際、この場合、「責任を負わない」ことに対して、ウェイトは罰金(または報酬)になります!

著者について

ホブソンレーン(Hobson Lane)は、人々の利益のために重要な決定を下す自律システムの構築に20年の経験があります。 Talentpairで、Hobsonは、ほとんどの採用マネージャーよりも偏りの少ない方法でレジュメを読んで理解するようにマシンに教えました。アイラでは、視覚障害者の周りの世界を解釈するように設計された最初のチャットボットの構築を支援しました。ホブソンは、AIのオープン性とコミュニティ主導のオリエンテーションを熱心に賞賛しています。彼は、Keras、scikit-learn、PyBrain、PUGNLP、ChatterBotなどのオープンソースプロジェクトに積極的に貢献しています。彼は現在、オープンソースの仮想アシスタントの作成など、TotalGoodのオープンリサーチおよび教育プロジェクトに携わっています。彼は数多くの記事を発表し、AIAA、PyCon、PAISとIEEEは、ロボット工学と自動化の分野でいくつかの特許を取得しています。

Hannes Max Hapkeは、電気技師から機械学習技師に転向しました。高校では、マイクロ波でニューラルネットワークを計算する方法を研究したときにニューラルネットワークに興味を持つようになりました。大学の後半に、彼はニューラルネットワークの原理を再生可能エネルギー発電所の効率的な管理に適用しました。 Hannesは、ソフトウェア開発と機械学習パイプラインの自動化に情熱を注いでいます。彼は、採用、エネルギー、ヘルスケア業界向けの深層学習モデルと機械学習パイプラインを共同執筆しています。 Hannesは、OSCON、Open Source Bridge、Hack Universityなど、さまざまな会議で機械学習に関するプレゼンテーションを行ってきました。

コールハワード(Cole Howard)は、機械学習の実践者、NLPの実践者、およびライターです。パターンの永遠の探求者である彼は、人工神経ネットワークの世界にいることに気づきました。彼の開発の中には、インターネットを介した取引のための大規模な推奨システムや、Kaggleコンペティションで1位にランクされている超高次元マシンインテリジェンスシステム(ディープニューラルネットワーク)のための高度なニューラルネットワークがあります。彼は、オープンソースブリッジとハック大学の会議で、畳み込み神経ネットワーク、反復神経ネットワーク、および自然言語処理におけるそれらの役割について講演しました。

表紙イラストについて

« -, ». (Balthasar Hacquet) Images and Descriptions of Southwestern and Eastern Wends, Illyrians and Slavs (« - , »), () 2008 . (1739–1815) — , , — , - . .

200 . , , . , . , .

200 . , , . , . , .

»ブックについての詳細はで見つけることができる出版社のウェブサイト

»目次

»抜粋

については居住者クーポンで25%割引- NLP

書籍の紙のバージョンの支払いの際、電子書籍は、電子メールに送信されます。