フォトクリスティアンクリスティアン上Unsplash

近い将来には、アマゾンエコーや巣のオーディオ音声スピーカーを活性化させるように挨拶せずにAppleデバイス上でGoogleやシリで検索することが可能となります「こんにちは、Googleの!」 AIの助けを借りて、米国の科学者は、スマートボイスアシスタントが人が話していることを理解するためのアルゴリズムを開発しました。

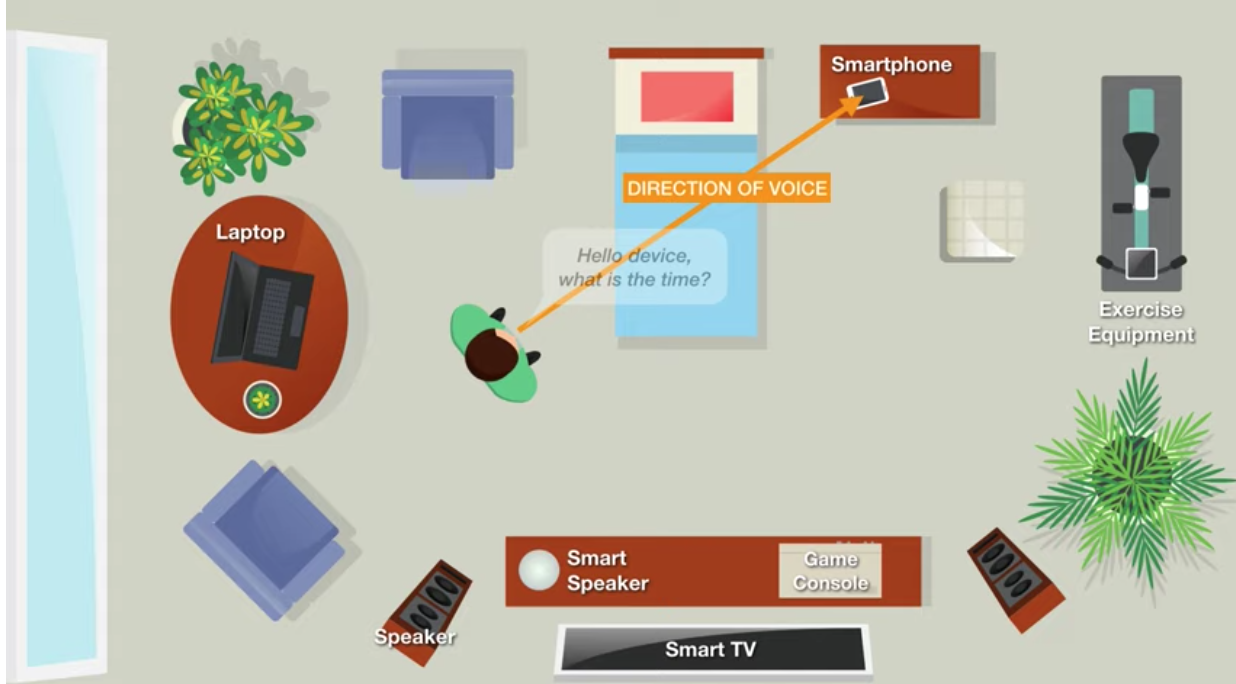

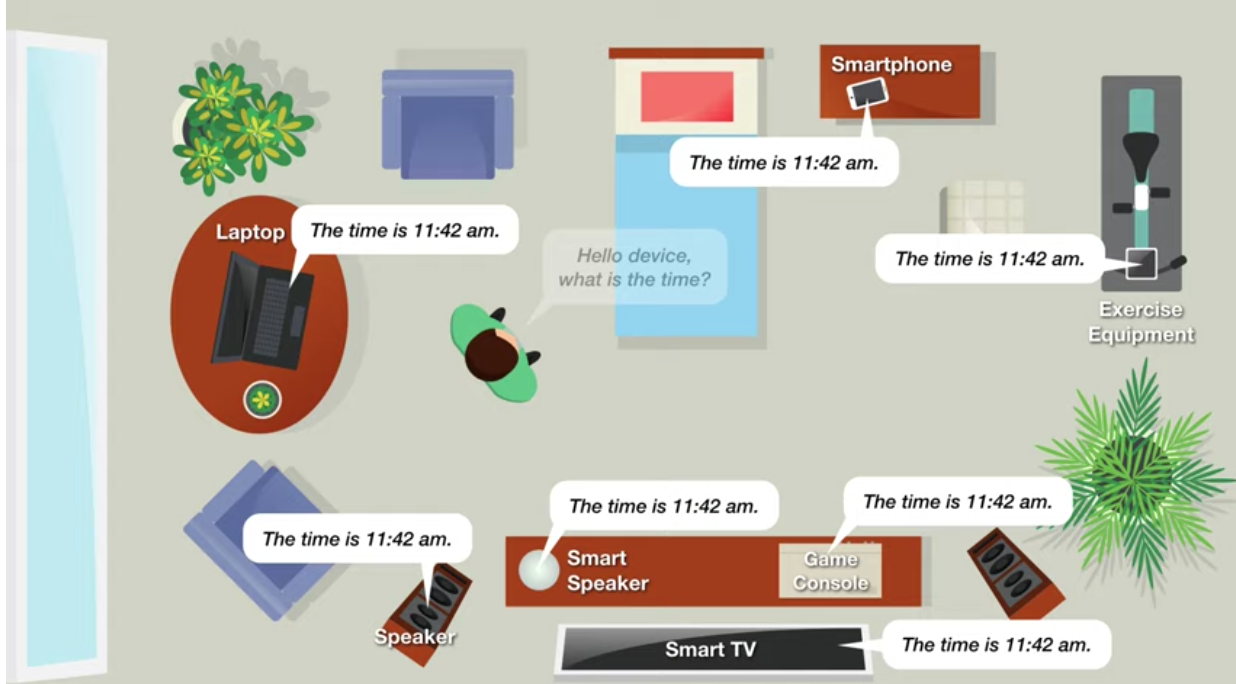

通常の会話では、人々はメッセージを見るだけでメッセージの宛先を指定します。しかし、ほとんどの音声デバイスは、実際のコミュニケーションでは誰も言わないキーフレーズを使用してアクティブ化するように調整されています。音声アシスタントによる非言語的な手がかりを理解すると、コミュニケーションがより簡単で直感的になります。特に家の中にそのような装置がいくつかある場合。

カーネギーメロン大学の科学者は、開発されたアルゴリズムがマイクを使用して音声の方向(DoV)を決定すると述べています。

DoVは、到着方向(DoA)の検出とは異なります。

研究者によると、DoVを使用すると、ターゲットを絞ったコマンドが可能になります。これは、会話を開始するときの対話者との目の接触に似ています。ただし、デバイスのカメラは関係ありません。したがって、混乱することなく、さまざまなタイプのデバイスとの自然な相互作用があります。

とりわけ、このテクノロジーは、常にスタンバイ状態にある音声アシスタントの偶発的なアクティブ化の数を減らします。

新しいオーディオテクノロジーは、音声伝播の機能に基づいています。音声がマイクに向けられている場合、それは低周波数と高周波数によって支配されます。音声が反射された場合、つまり最初に別のデバイスに向けられた場合、低周波数と比較して高周波数が著しく減少します。

アルゴリズムはまた分析します最初の10ミリ秒での音の伝播。ここでは、2つのシナリオが考えられます。

ユーザーがマイクの方を向いている。マイクに最初に到着する信号は、家の他のデバイスから反射される可能性のある他の信号と比較して明確になります。

ユーザーはマイクから離れます。すべての音の振動は複製され、歪められます。

アルゴリズムは信号の形状を測定し、その強度のピークを計算し、それを平均値と比較して、音声がマイクに向けられているかどうかを判断します。

声の広がりを測定することにより、科学者は93.1%の精度で、スピーカーが特定のマイクの前にあるかどうかを判断することができました。彼らは、これがこれまでで最高の結果であり、既存のデバイスにソリューションを実装するための重要なステップであると述べました。人がデバイスを見る8つの角度の1つを決定しようとすると、65.4%の精度が達成されました。これは、アプリケーションにとってはまだ十分ではありません。その本質は、ユーザーとのアクティブな対話です。

情報を収集するために、エンジニアはPythonを使用し、信号はExtra-Trees分類子アルゴリズムに基づいて処理されました。

開発中に収集されたデータとアルゴリズムはGitHubに公開されています。独自の音声アシスタントを作成するときに使用できます。