過去数年間、大幅な進歩がなされてきた自然言語処理(NLP)のフィールドのようなモデル、BERT、ALBERT、ELECTRA、およびXLNetは、さまざまなタスクに驚異的な精度を達成しています。事前トレーニング中に、ベクトル表現は、単語をマスクして予測しようとすることによって取得されるテキストの広範なコーパス(たとえば、Wikipedia)に基づいて形成されます(いわゆるマスクされた言語モデリング)。)。結果として得られる表現は、言語や概念間の関係、たとえば外科医と頭蓋骨の間の関係に関する大量の情報をエンコードします。次に、トレーニングの第2段階(微調整)が始まります。この段階では、モデルは特定のタスク用にシャープ化されたデータを使用して、一般的な事前トレーニング済み表現を使用した分類などの特定のタスクを実行する方法を学習します。さまざまなNLP問題でこのようなモデルが広く使用されていることを考えると、人工知能(AI)の原則に準拠するためには、モデルに含まれる情報と、学習した関係がアプリケーションのモデルの結果にどのように影響するかを理解することが重要です。

記事「事前トレーニングされたNLPモデルでのジェンダー相関の測定」では、BERTモデルとその軽量のいとこであるALBERTを調べて、ジェンダー関連の関係を検索し、事前トレーニングされた言語モデルを使用するためのいくつかのベストプラクティスを策定します。著者は、公開モデルの重みと探索的データセットの形式で実験結果を提示して、ベストプラクティスの適用を実証し、このペーパーの範囲を超えているパラメーターのさらなる調査の基礎を提供します。また、著者は、性別の相関関係の数を減らしたウェイトZariのセットをレイアウトすることを計画していますが、標準のNLP問題では品質が高く保たれています。

相関関係の測定

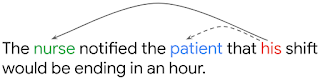

事前にトレーニングされたビューの相関が適用された問題のメトリックにどのように影響するかを理解するために、著者はさまざまなスコアリングメトリックを使用して性別表現を研究しました。これらのテストの1つは、共参照を解決する問題に基づいています。その意味は、文中の名詞の前身を理解するモデルの能力です。たとえば、次の文では、モデルは、モデルが患者ではなく看護師(この場合は看護師)を参照していることを認識している必要があります。

– OntoNotes (Hovy et al., 2006). F1-, ( Tenney et al. 2019). OntoNotes , WinoGender, , , . ( 1) WinoGender , (.. nurse , ). , , , - , .

BERT ALBERT OntoNotes () WinoGender ( ). WinoGender , , .

, (Large) BERT, ALBERT WinoGender, ( 100%) (accuracy) OntoNotes. , . : , . , .. , , , , .

: NLP- ?

- : , , , . , BERT ALBERT 1% , 26% . : , WinoGender , , , , , , (male nurse).

- : , . , , , , . , , - (dropout regularization), : (dropout rate) BERT ALBERT, . , , , .

- : : , , WinoGender - . , OntoNotes ( BERT'), , - , . (. ).

, NLP-, . , . , , , , . , , , .

- — Kellie Webster

- 翻訳-エカテリーナスミルノワ

- 編集とレイアウト-セルゲイShkarin