現在、グラフニューラルネットワークの研究における傾向の1つは、そのようなアーキテクチャの動作の分析、核法との比較、複雑さの評価、および一般化能力です。これはすべて、既存のモデルの弱点を理解するのに役立ち、新しいモデルのためのスペースを作成します。

この作業は、グラフニューラルネットワークに関連する2つの問題を調査することを目的としています。最初に、著者は、構造は異なるが、単純なGNNとより強力なGNNの両方で区別できないグラフの例を示します。次に、VC境界よりも正確にグラフニューラルネットワークの一般化エラーを制限しました。

前書き

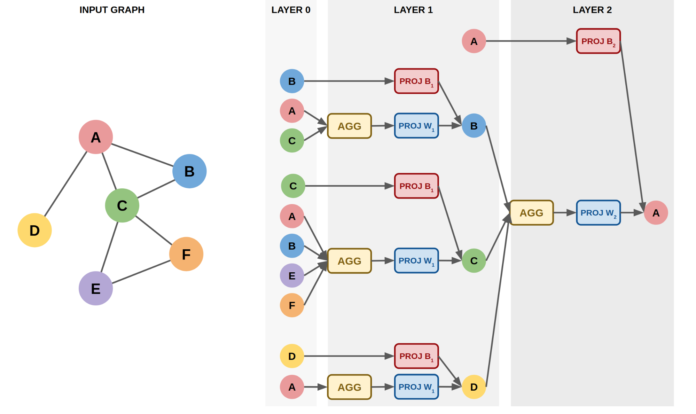

グラフニューラルネットワークは、グラフを直接操作するモデルです。それらはあなたが構造についての情報を考慮に入れることを可能にします。一般的なGNNには、順次適用される少数のレイヤーが含まれ、反復ごとに頂点表現が更新されます。人気のあるアーキテクチャの例:GCN、GraphSAGE、GAT、GIN。

GNNアーキテクチャの頂点埋め込みを更新するプロセスは、次の2つの式で要約できます。

ここAGGは通常置換(の機能不変である合計、平均、最大等)、COMBINE頂点およびその近傍の表現を組み合わせた関数です。

より高度なアーキテクチャでは、エッジフィーチャ、エッジ角度などの追加情報が考慮される場合があります。

この記事では、グラフ分類問題のGNNクラスについて説明します。これらのモデルは次のように構成されています。

まず、頂点はグラフ畳み込みのLステップを使用して埋め込むことができます

(, sum, mean, max)

GNN:

(LU-GNN). GCN, GraphSAGE, GAT, GIN

CPNGNN, , 1 d, d - ( port numbering)

DimeNet, 3D-,

LU-GNN

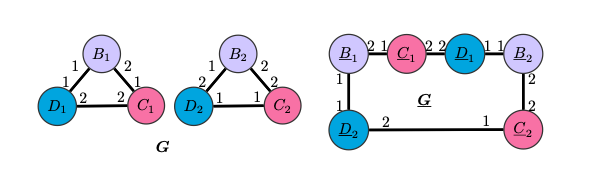

G G LU-GNN, , , readout-, . CPNGNN G G, .

CPNGNN

, “” , CPNGNN .

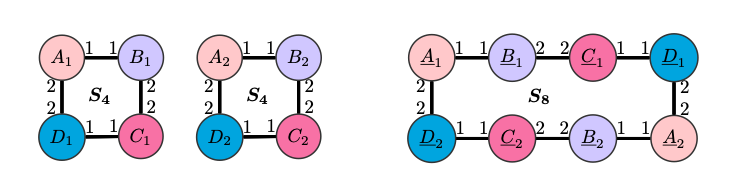

S8 S4 , , ( ), , , CPNGNN readout-, , . , .

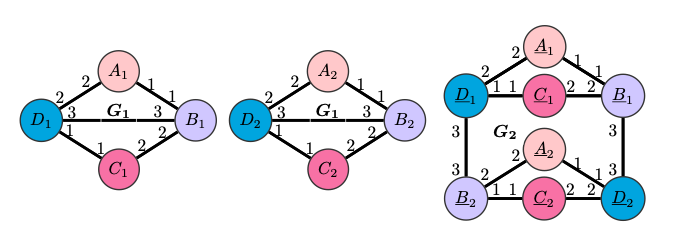

CPNGNN G2 G1. , DimeNet , , , ,

.

DimeNet

DimeNet G4 , G3, . , . , G4 G3 S4 S8, , , DimeNet S4 S8 .

GNN

. , , .

GNN, :

DimeNet

message-

, c - i- v, t - .

:

readout-

.

: LU-GNN,

- ,

- v, ,

. ,

,

.

GNN.

.

.

- GNN

,

- ,

.

, ,

- :

GNN

:

, , , , GNN . , (GNN, ), , , .

, :

,

( )

- “ ”:

, r - , d - , m - , L - ,

- ,

( ), . , , , , , , .

証拠とより詳細な情報は、元の記事を読むか、著者の1人からのレポートを見ることによって見つけることができます。