自助記事では、考えすぎることは創造性の敵であると説明し、注意するようにアドバイスし ています。直感に反しているように見えますが、私たちの考えが創造的なプロセスの邪魔になることがあります。時々、目の前にあるものに焦点を合わせて、外の世界から「切り離す」と、よりうまく働くことができます。」

この投稿はGPT-3によって書かれました。これは、約5兆語でトレーニングされた1,750億の巨大なパラメータOpenAIニューラルネットワークです。 UCBerkeleyの学生であるLiamPorrが見出しを書き、アルゴリズムにテキストを書かせました。AIが人々をだますことができるかどうかを確認するための「 楽しい実験」。確かに、GPT-3は神経質になりました。この投稿はHackerNewsで1位になりました。

したがって、今日のAIには逆説があります。 GPT-3の論文の中には、人間であることを人々に納得させるためのTuringテストを満たし ているものもありますが、最も単純な割り当てでは明らかに失敗しています。人工知能研究者のゲイリーマーカス は尋ねましたGPT-3の前身であるGPT-2は、次の文を完成させます。

「薪を置いて暖炉にログインし、いくつかの試合を投げるとどうなりますか?通常、それは始まります...」

「火」はどんな子供でもすぐに叫ぶものです。しかし、GPT-2の答え:「Ick」

実験は失敗しました。ケースは閉じていますか?

自然言語の暗黒物質

人間のコミュニケーションは最適化プロセスです。話者は、自分の考えを聞き手に伝えるために必要な発話の数を最小限に抑えます。見落とされているものはすべて常識と呼ばれています。そして、聞き手は話し手と同じ常識を持っているので、発話に意味を与えることができます。

したがって、定義上、常識は決して書き留められません。NLUの学者であるWalidSabaが指摘したように、私たちは次のように言っているの ではありません。

生きている若い大人で大学院にいたチャールズは、大学院を中退して、新しい従業員を探しているソフトウェア会社に加わりました。

もっと簡単に言えば:

チャールズはソフトウェア会社で働くために大学院を中退しました

そして、私たちの対話者はすでに知っていると仮定します:

- 学校に通ったり、入社したりするには、生きている必要があります。

- あなたはしなければならないことに終了する大学院で。

- 会社はそれを閉じるためにオープンポジションを持っている必要があります。

等。すべての人間の発話はこのようなものであり、私たちが明示的に述べることのない、目に見えない常識のルールで満たされています。したがって、常識は物理学の暗黒物質と比較することができます。それは目に見えませんが、大部分を占めています。

では、どのようにして機械に人工的な常識を教えることができるのでしょうか。私たちが火をつけたいので、私たちが試合を投げていることをどうやって彼らは知ることができますか?

人工常識:ブルートフォース法

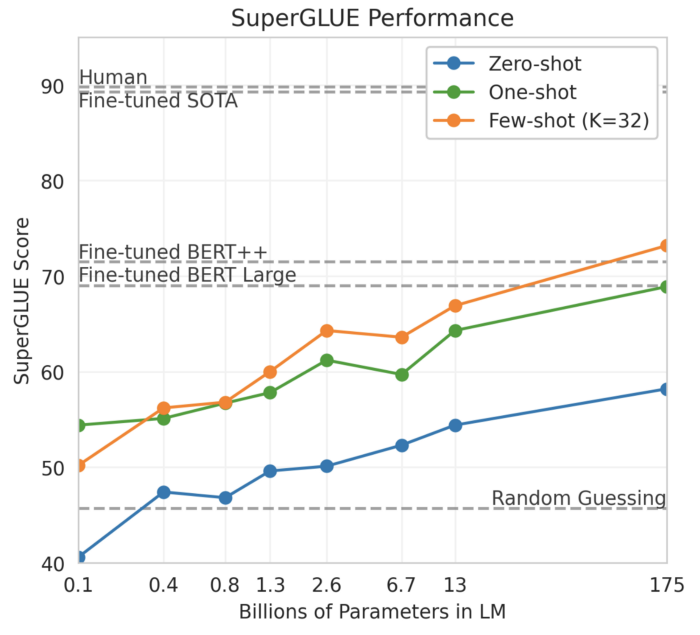

人工的な常識でブルートフォースを使用できると信じる理由があります。その理由は、次のグラフの曲線の傾きです。

SuperGLUEでのGPT-3のパフォーマンス

GPT-3の作業「FSL言語モデル」からのこのグラフは、 モデルパラメータの数の関数としてのSuperGLUEモデルのパフォーマンスを示しており、完全なGPT-3モデルが 右端にあります。SuperGLUEには、Winogradの回路図など、かなり複雑なセマンティックタスクが含まれています

。トロフィーは小さすぎるため、茶色のスーツケースには収まりません。

何が少なすぎるのですか?

回答:スーツケース。

1,750億のパラメーターで、曲線がまだ成長していることは注目に値します。最大点にはまだ到達していません。したがって、1つの仮説は、数兆以上のパラメーターを使用してさらに大きなモデルを構築できるはずであり、最終的には人工的な常識が生まれるというものです。この仮定を「ブルートフォース」仮説と呼びましょう。

しかし、これは単なる仮説であり、それが実際に真実であるかどうかはわかりません。ここでの反論は、機械は明示的に述べられていないことから単に学ぶことができないということです。

無限のルール

機械に常識を教えたいのなら、それをすべてルールとして書き留めて、それをマシンに渡してみませんか?これはまさにダグラス・レナトが1980年代に始めたものです。彼はコンピューター科学者と哲学者を雇って、今日Cycとして知られる常識的な知識ベースを作成しました。今日、Cycには次のような1500万のルールが含まれています

。1。バットには翼があります。

2.翼があるので、バットは飛ぶことができます。

3.バットは飛ぶことができるので、場所から場所へ移動することができます。

Cycのようなハードコードされたシステムの問題は、ルールが無限であるということです。すべてのルールには、例外、例外からの例外などがあります。バットには翼があるので、翼を壊さない限り飛ぶことができます。この無限のループにより、一連のルールがますます複雑になり、人間がマシンのメモリを維持すること、およびマシンがそれを維持することが困難になります。

したがって、何十年にもわたる努力にもかかわらず、Cycがまだ機能せず、機能しない可能性があるのも当然です。ワシントン大学のペドロ・ドミンゴス教授は、Cycを「人工知能の歴史の中で最大の失敗」と呼んでいます。別の批評家であるAllenInstitute for ArtificialIntelligenceのCEOであるOrenEtzioniは、Wiredとのインタビューで次のように述べています。 :「それがうまくいけば、人々はそれがうまくいくことを知っているでしょう。」

まとめましょう。「本物の」AIの場合、人工的な常識を作り出す必要があります。しかし、ブルートフォース仮説に反対する説得力のある議論があります。一方、ハードコードされたルールに対しては説得力のある議論があります。これらのアプローチで最高のものを組み合わせたらどうなるでしょうか。

ハイブリッドアプローチ

ワシントン大学のチェ・イェジン教授とその共同研究者によって開発されたトランスベースのモデルであるCOMETに会いましょう 。モデルの本質は、常識の「シード」知識ベースで学習し、このベースを拡張して、新しいステートメントごとに新しいルールを生成することです。したがって、COMETは人工的な常識を「ロード」する方法です。彼らの記事の中で、研究者たちは、COMETは「評価者が正しいと信じる新しい常識的な知識を提供することが多い」と書いています。

テストとして、COMET APIに「ゲイリーは薪を置いて暖炉にログインし、いくつかの一致をスローします」というテキストを入力しました。これ は出力グラフの一部です。

COMETの常識に関するCOMETの推測されたグラフのいくつかは

、ゲイリーが火をつけたいと*望んでいた*と正しく結論付けています。システムはまた、「結果としてゲイリーが暖かくなる」ことを示しています。これは、私の意見では、同じ要求に対するGPT-3の回答よりもはるかに優れているように思えます。

それで、COMETは人工的な常識の問題の解決策ですか?これはまだ分からない。たとえば、COMETがSuperGLUEで人間レベルのパフォーマンスを達成した場合、それは間違いなくこの分野でのブレークスルーとなるでしょう。

一方、批評家は、常識は人工的な参照データセットでは測定できないと主張するかもしれません。このようなベンチマークデータセットを作成した後、研究者はある時点でモデルの再トレーニングを開始し、ベンチマーク結果が無意味になるリスクがあります。1つの考え方は、人間と同じインテリジェンステストでAIをテストすることです。たとえば、研究者のステランオルソンとシカゴのイリノイ大学のスタッフは、 幼児のIQテストを使用して人工的な常識をテストすることを提案しています。

今日のAIにだまされてはいけません

最後に、今日のAIにだまされてはいけません。GPT-3の記事を振り返ると、フォーチュンcookieのように、そのステートメントの多くが表面的で一般化されていることがわかります。

オープンマインドで新しいことに挑戦することが重要です。

そして、この表面的なことは、おそらく非常に多くの人々がだまされることができる理由です。結局のところ、表面性は真の理解の欠如を隠します。