著者: Eugenio Culurciello、原題: RNN / LSTM の陥落

翻訳: ダヴィドフ A.N.

RNN (リカレント ニューラル ネットワーク)、LSTM (長短期記憶)、およびそれらのすべてのバリアントが気に入りました。そして今、それらをあきらめる時が来ました!

2014 年に LSTM と RNN が復活しました。しかし、私たちは若く、経験が浅かった。数年間、それらは逐次学習、配列翻訳 (seq2seq) などの問題を解決する方法でした。彼らはまた、スピーチを理解し、それをテキストに翻訳することにおいて驚くべき結果を達成することを可能にしました。これらのネットワークは、Siri、Cortana、Google、Alexa などの音声アシスタントの台頭を後押ししてきました。機械翻訳を忘れないでください。これにより、ドキュメントをさまざまな言語に翻訳できます。または、ニューラル ネットワークの機械翻訳で、画像からテキストへ、テキストから画像へ、動画の字幕を作成することができます。

その後、2015 年から 2016 年にかけて ResNet と Attention が登場しました。その後、LSTM は問題を解決するのではなく、回避するための巧妙なテクニックであることが理解され始めました。また、MLP ネットワーク (多層パーセプトロン ニューラル ネットワーク) は、コンテキスト ベクトルによって駆動される平均化ネットワークに置き換えることができることも示されました。(これについては後で詳しく説明します)。

わずか 2 年しか経っていないが、今日、私たちは確かに次のように言うことができる。

「RNN と LSTM をノックアップしてください。それらはあまり良くありません!」

, , Attention , , . RNN Attention . RNN , , Attention.

?

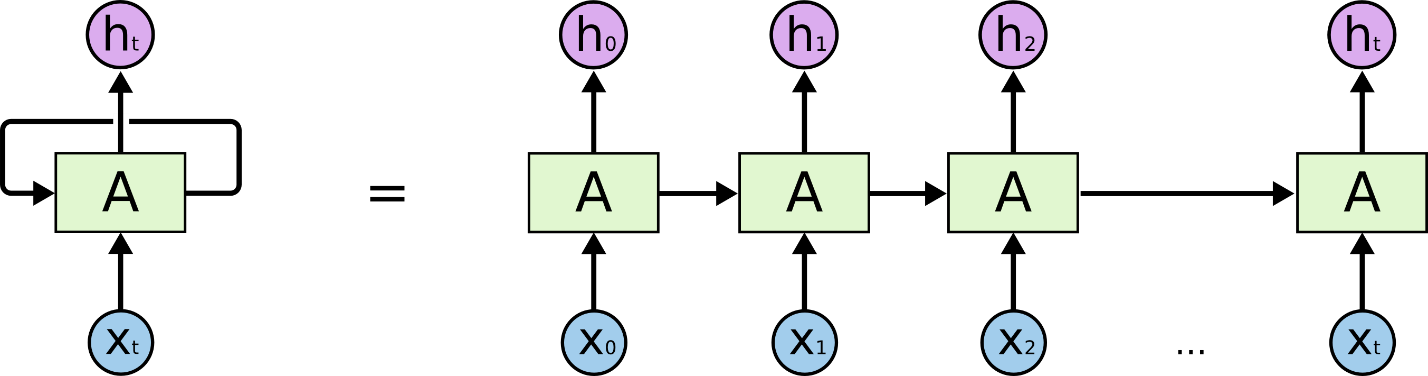

, RNN, LSTM . :

, , . , , 0, .

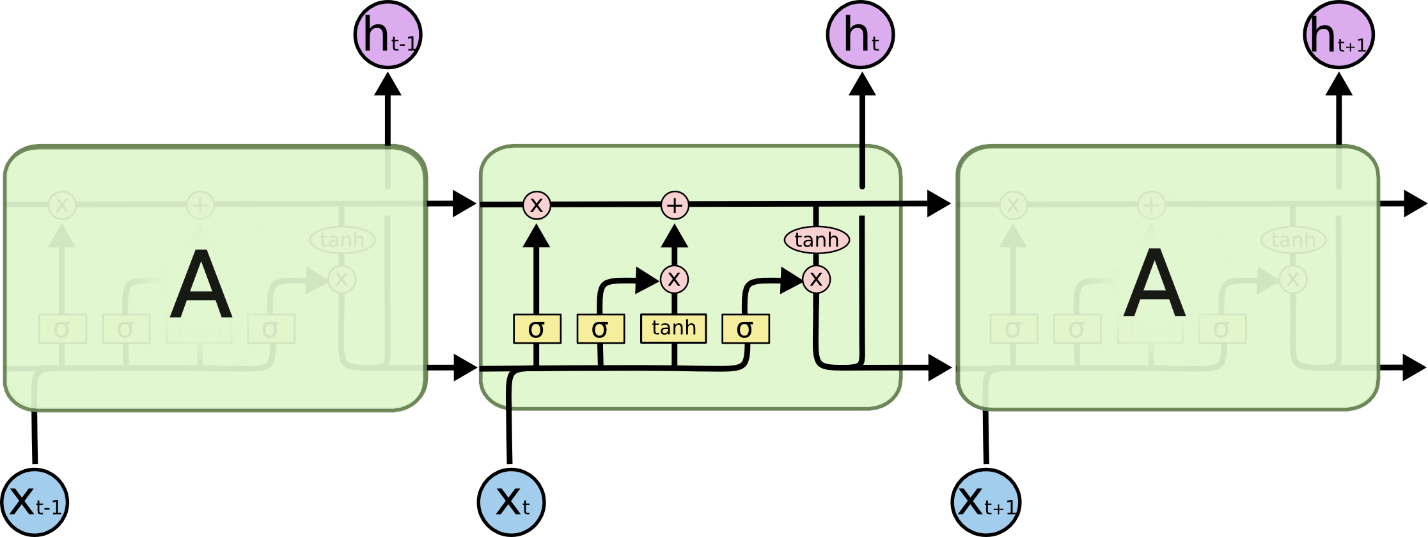

LSTM. , , ResNet. () . LSTM . .

. , , . , LSTM, GRU ! (100), .

RNN , . , ( ), . RNN . , , , Amazon Echo!

?

2D , RNN/LSTM, Attention, Transformer

Transformer 2017 , . , .

: , , « » , « », - ( ) , , . , / .

« », , :

- , Ct

, , . (TCN), 3 .

«» , 100 , 100 «» 100 . 100100 . 10 000 .

, .

, , , : , N (log(N)), N – . , RNN, – . T N (T>>N)

, 3-4 100!

, , «». , , .

? , . , , : , – , . , , . , . , , , .

– RNN . Attention. , - , !

RNN\LSTM: RNN LSTM , , . , LSTM 4 ( MLP) . , , . , ( , . .). RNN / LSTM , . , , FWDNXT.

1: WaveNet. . : .

2: RNN LSTM - ( . ). () , / , ! , - . - , ( ).

3: , CNN RNN. (TCN) « , LSTM, , ».

4: , , . « , , 858 534 22 30, . , »- , «» (Attention), , , (TCN). , RNN, , . , (, 5 ), , , , .

5: , , , . «» . , ! !

6: Attention Transformer, . VGG NLP? , LSTM , . LSTM Transformer ( ), , , « LSTM Transformer - MRPC »